Optimización de Infraestructura IT: Qué Marca Realmente la Diferencia

La mayoría de guías sobre optimización de infraestructura IT se leen como un libro de texto. Evalúa tus sistemas, haz un plan estratégico, actualiza el hardware, implementa DevOps. Técnicamente correcto, prácticamente inútil. Los equipos no necesitan un checklist de buzzwords. Necesitan saber qué cambios dan resultados reales y cuáles son solo overhead disfrazado de progreso.

Este post se centra en las optimizaciones que realmente marcan una diferencia medible para equipos que ejecutan cargas de trabajo en producción, y en cómo la infraestructura de CubePath está diseñada para soportarlas.

Empieza por Lo Que Es Lento

Antes de optimizar nada, identifica qué es realmente lento. No lo que parece lento, no lo que un blog dice que debería ser lento. Mídelo.

Latencia de almacenamiento. Si las queries de base de datos son lentas, lo primero que hay que comprobar es la capa de almacenamiento. Los discos mecánicos e incluso los SSD estándar añaden milisegundos a cada operación de I/O. Migrar a almacenamiento NVMe, que es estándar en todos los VPS y bare metal de CubePath, típicamente reduce la latencia de queries entre un 50-80%. Este solo cambio a menudo tiene más impacto que cualquier optimización a nivel de aplicación.

Overhead de red. Si los servicios se comunican por internet público cuando podrían estar en una red privada, cada llamada API entre ellos añade latencia innecesaria y expone el tráfico. La red privada de CubePath con MTU 9000 mantiene la comunicación entre servicios rápida y fuera de internet público.

Cuellos de botella de CPU. Si la aplicación está limitada por CPU, ejecutarla en infraestructura compartida donde el tiempo de CPU está disputado significa que el rendimiento varía de forma impredecible. Mover la carga de trabajo a una instancia Dedicated CPU o bare metal elimina la variabilidad.

Tipo de instancia equivocado para la carga. Una base de datos que consume mucha memoria corriendo en una instancia optimizada para CPU desperdicia dinero y rinde peor. Encajar la carga de trabajo con el tipo de instancia adecuado (Shared CPU para tareas ligeras, High Frequency para trabajo sensible a latencia, Dedicated CPU para cómputo sostenido) es una de las optimizaciones más simples y efectivas.

Automatiza Lo Que los Humanos No Deberían Estar Haciendo

La gestión manual de servidores no escala. Si desplegar un nuevo servidor implica entrar por SSH, ejecutar comandos, configurar servicios y esperar que la documentación esté actualizada, el proceso es frágil y lento.

Infraestructura como Código. Define servidores, redes, firewalls y DNS en Terraform. Cuando la infraestructura es código, está versionada, revisada por pares y es reproducible. El Terraform provider de CubePath soporta VPS, proyectos, redes y claves SSH, así que el stack completo se puede definir en archivos y aplicar con un comando.

Automatización con CLI y API. CubeCLI y la API de CubePath permiten automatizar todo lo que hace el panel. Aprovisionar un servidor, configurar un Load Balancer, gestionar registros DNS. Si se puede hacer manualmente, se puede automatizar.

Operaciones programadas. Backups, rotación de logs, renovación de certificados. Estas tareas nunca deberían depender de que un humano se acuerde de hacerlas. Automatiza el trabajo rutinario para que el equipo se centre en el trabajo que requiere criterio.

Escala de la Forma Correcta

El escalado vertical (servidor más grande) funciona hasta que deja de funcionar. Siempre hay un techo, y el salto de un tier al siguiente se encarece. El escalado horizontal (más servidores detrás de un Load Balancer) es más resiliente y a menudo más rentable.

Los Load Balancers de CubePath distribuyen tráfico entre múltiples instancias VPS con health checks automáticos. Si una instancia falla, el tráfico se enruta a las sanas. Combinado con facturación por horas, esto significa que escalar para un pico de tráfico cuesta exactamente lo que valen esas horas extra de cómputo, y escalar hacia abajo es tan simple como destruir las instancias extra.

Para cargas stateless (servidores web, backends API, workers), el escalado horizontal detrás de un Load Balancer es casi siempre la mejor opción. Para cargas stateful (bases de datos, colas persistentes), el escalado vertical en Dedicated CPU o bare metal con replicación adecuada proporciona tanto rendimiento como fiabilidad.

Monitoriza Antes de Necesitarlo

El peor momento para montar monitorización es durante una caída. CubePath Cloud Alerts permite configurar alertas basadas en recursos (CPU, memoria, disco, red) con notificaciones a Slack, Email u otros canales.

Saber que un disco está al 85% antes de que llegue al 100% es la diferencia entre una expansión planificada y una emergencia a las 3 de la mañana. Saber que el uso de CPU ha estado subiendo constantemente durante la última semana da tiempo a investigar y optimizar antes de que los usuarios empiecen a quejarse.

Dimensiona la Infraestructura Correctamente

Sobreprovisionar es cómodo pero caro. Infraprovisionar es barato hasta que causa una caída. El objetivo es encajar los recursos con el uso real.

La facturación por horas de CubePath hace que dimensionar correctamente sea de bajo riesgo. Empieza con una instancia más pequeña, monitoriza el uso real de recursos y redimensiona hacia arriba si es necesario. Para cargas variables, la combinación de Load Balancers y facturación por horas crea infraestructura genuinamente elástica. Más instancias en horas punta, menos fuera de horas, y la factura refleja el uso real en vez de la capacidad pico.

La Infraestructura que Soporta Todo Esto

La optimización no es solo lo que corre encima de la infraestructura. La propia infraestructura importa:

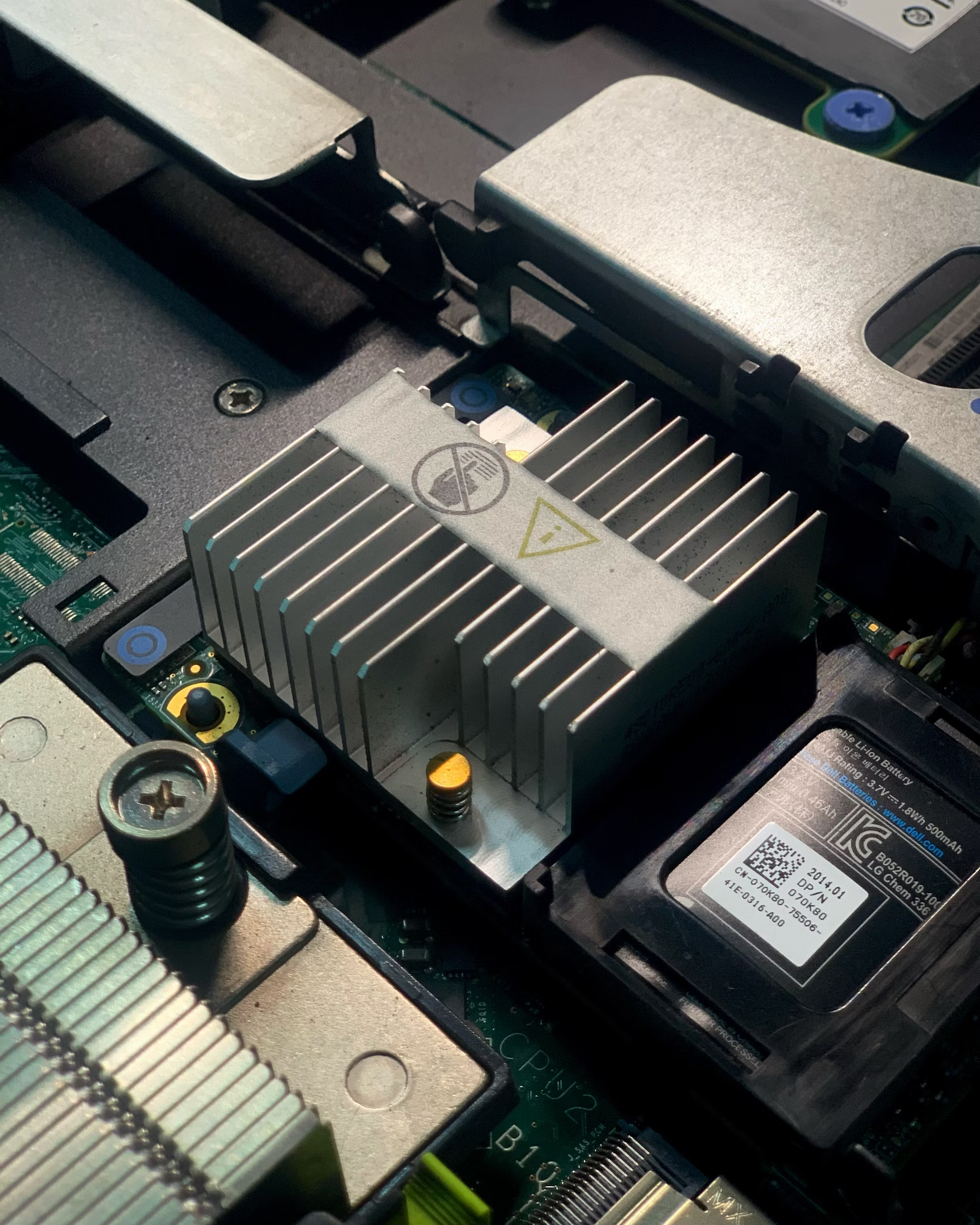

- Almacenamiento NVMe en todas partes elimina el cuello de botella de I/O más común

- Red privada con MTU 9000 hace la comunicación entre servicios rápida y gratuita

- Múltiples tipos de instancia permiten encajar el hardware con las características de la carga

- Facturación por horas elimina la penalización por experimentar y dimensionar correctamente

- Load Balancers con health checks habilitan escalado horizontal sin setups HAProxy personalizados

- Terraform, CLI y API hacen la infraestructura reproducible y automatizable

- Cloud Alerts proporcionan monitorización proactiva sin construir un stack de monitorización

- Protección DDoS incluida significa que la seguridad no requiere configuración adicional

La mejor optimización es elegir infraestructura que no cree cuellos de botella de entrada.